一、开篇引言

上一世,我困在大模型部署的混沌深渊里。

对着满屏的报错红字手足无措,CUDA 版本冲突、显存溢出熔断、模型下载卡死、Hugging Face 遥不可及。心仪的开源模型躺在云端,我却只能隔着屏幕仰望,用尽方法都无法将它拉回本地,沦为只会调用在线接口的门外汉,在无数次失败后颓然退场。

而此刻,意识重回起点,所有踩过的坑、吃过的苦、记满笔记的排查经验,全都化作刻印在灵魂里的记忆。

这一世,我不再走弯路、不再被晦涩文档劝退、不再屈服于硬件与环境的桎梏。以 Hugging Face 为匙,以重生的经验为刃,从零开始,破开部署的层层壁垒,将那些只存在于平台上的耀眼模型,真正掌控在自己手中。

无需高深算法功底,不必畏惧复杂环境,这一次,我要亲手完成救赎 —— 从零搭建环境,加载、运行、对话,成功部署属于我的第一个大模型。凡昨日困住我的阻碍,今日皆为我登顶的基石。

二、 前期准备

上一世就是因为轻视了前期准备,踩了环境冲突、显存不足的致命深坑,这一世必须步步为营,筑牢部署的根基,不给失败任何可乘之机!

2.1 硬件门槛:划定你的“战力边界”

想要承载心仪的大模型,必先明确自身硬件的“战力上限”,否则再精妙的操作,也会败在显存不足的绝境之中。

推荐配置(流畅作战):NVIDIA 独立显卡(显存 ≥ 10G,如 RTX 3060 12G、RTX 4090)、内存 ≥ 16G、硬盘剩余空间 ≥ 20G(用于存放模型权重,越大越好)。此配置可流畅运行 7B 量级模型(FP16 精度),实现无卡顿对话。

最低配置(勉强一战):NVIDIA 独立显卡(显存 ≥ 6G)、内存 ≥ 8G、硬盘剩余空间 ≥ 10G。仅能运行 1.8B/2B 量级小模型,或对 7B 模型进行量化后部署,速度略缓但可完成核心流程。

无卡绝境(破局之法):若无独立显卡,可选择两条出路——① CPU 推理(战力暴跌,速度极慢,仅用于验证部署流程,不适合实际使用);② 借助 Colab 免费 GPU(临时获取云端战力,无需本地硬件,适合新手入门实操)。

核心知识点(重生记忆加持):模型参数量与显存的对应关系(刻进DNA)——FP32 精度下,1B 参数量约需 4G 显存;FP16 精度下,1B 参数量约需 2G 显存(节省一半战力);量化后(INT8/4),可进一步压缩至 1G/0.5G 左右,让低配置也能撬动大模型。

2.2 软件环境:搭建你的“专属作战平台”

硬件是肉身,环境是灵魂,上一世就是因为环境版本冲突,让即将成功的部署功亏一篑。这一世,我们将搭建一个隔离、稳定的作战平台,杜绝一切版本之乱。

步骤1:搭建隔离环境(避坑第一要务,推荐 Anaconda)

普通环境容易被其他项目污染,导致依赖冲突,Anaconda 就像一个“专属结界”,为大模型部署开辟独立空间,互不干扰。

下载安装:前往 Anaconda 官方网站(附传送门),根据自身系统(Windows/macOS/Linux)下载对应安装包,无脑下一步安装即可(记得勾选“添加环境变量”,避免后续手动配置)。

创建结界(独立虚拟环境):打开 Anaconda Prompt(Windows)或终端(macOS/Linux),输入以下命令,创建名为

llm_deploy(可自定义)、Python 3.10(稳定版,兼容性拉满)的虚拟环境:

conda create -n llm_deploy python=3.10进入结界:激活创建好的虚拟环境,此后所有操作均在该结界内进行,命令如下:

conda activate llm_deploy(提示:终端前缀出现 (llm_deploy),即表示成功进入结界)

为什么这里不使用别的虚拟环境呢?

Q: 大佬大佬,为什么不使用uv呢?听说这个很强呀

A: 道友,作为重生者,我当然知晓 uv 这款新晋「环境 / 包管理战神」—— 它由 Rust 编写,安装速度秒杀 pip,环境隔离也足够优秀,堪称新时代的效率利器。但这一世开篇,我依然优先推荐 Anaconda,而非 uv,核心原因只有一个:「稳」字当头,为新手杜绝一切不必要的额外翻车可能。Anaconda可不是单纯的包管理器,而是自带了很多预编译的包,对Windows系统友好,完美解决「某些包需要编译、缺少编译器导致安装失败」的致命问题,上一世我就是因为缺少一些环境卡了整整一天。

步骤2:部署 GPU 驱动(CUDA Toolkit,GPU 战力激活关键)

若使用 NVIDIA 显卡进行推理,必须安装 CUDA Toolkit,它是激活 GPU 并行计算战力的“密钥”,上一世就是因为 CUDA 版本与 PyTorch 不匹配,导致 GPU 无法调用,白白浪费硬件战力。

版本选择:核心原则——CUDA 版本无需最新,只需与后续安装的 PyTorch 兼容。同时,需确保显卡驱动版本满足 CUDA 要求。

下载安装:前往 NVIDIA 官方 CUDA Toolkit 下载页面,选择 CUDA 版本,根据系统选择对应安装包,按照指引安装即可(无需手动配置环境变量,安装程序会自动处理)。

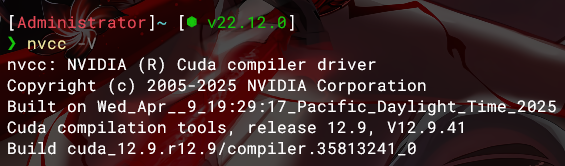

验证密钥是否生效:在终端输入以下命令,若能显示 CUDA 版本信息,即表示激活成功:

nvcc -V

道友留步(注意):这里V是大写的。

步骤3:安装核心依赖(Hugging Face 作战套件,缺一不可)

这是部署的核心战力组件,我们将安装 transformers(Hugging Face 核心作战武器)、torch(深度学习框架,承载模型运行)等关键依赖,且锁定版本,杜绝冲突。

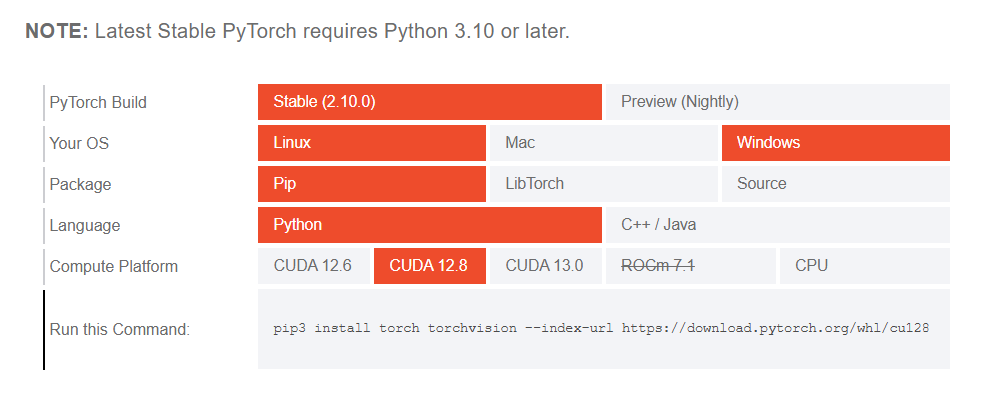

(1) 先安装 PyTorch(带 CUDA 支持,激活 GPU 战力):

刚才道友已经查询了CUDA的版本,可以看见我已经安装了CUDA 12.9,然后我们去传送门查看对应版本的PyTorch

pip3 install torch torchvision --index-url https://download.pytorch.org/whl/cu128道友留步(注意):Compult Platform选择的版本需要≤你的CUDA的版本,这里我选择12.8≤12.9。

(2)再安装 Hugging Face 核心套件及辅助依赖:这些是操作模型、优化显存的关键,输入以下命令一键安装:

pip install transformers accelerate sentencepiece protobuftransformers:由HuggingFace提供的核心武器,提供模型加载、分词、推理的全套功能,是操作开源模型的必备工具。accelerate:显存优化神器,可自动分配模型到 GPU/CPU,为低配置设备“续命”。sentencepiece/protobuf:辅助组件,解决部分模型(如 Qwen、Llama)的分词报错、结构解析问题,上一世就是少装了这些,导致模型加载失败。

验证作战平台是否就绪:在终端输入

python进入交互环境,运行以下代码,若无报错且显示True,即表示环境搭建成功,GPU 战力已激活,可随时出征:

import torch

from transformers import pipeline

# 验证 PyTorch 是否可用,GPU 是否被识别

print("PyTorch 版本:", torch.__version__)

print("GPU 是否可用:", torch.cuda.is_available())2.3 选定目标:挑选你心仪的“开源战神”

硬件与环境已就绪,此刻需从 Hugging Face Hub 这个“战神宝库”中,挑选一款适合自己的开源模型,上一世我贪大求全,选择了显存要求极高的 13B 模型,最终惨败,这一世必须量力而行,选择新手友好的“战神”。

步骤1:进入战神宝库(Hugging Face Hub)

Hugging Face Hub 是全球最大的开源模型宝库,汇聚了无数优质大模型,传送门

步骤2:新手友好战神推荐(量力而行,避免翻车)

作为重生者,我推荐以下几款“低战力要求、高性价比”的模型,中文支持优秀,部署简单,适合新手入门:

Qwen/Qwen2.5-0.5B:0.5B 参数量,显存要求极低(FP16 仅需 1G 左右),中文理解与生成能力优秀,对话流畅,无需复杂配置,新手首选。

zai-org/chatglm3-6b:6B 参数量,生态成熟,文档齐全,踩坑指南丰富,中文表现顶尖,支持多轮对话,适合想要体验稍大模型的新手。

deepseek-ai/DeepSeek-R1-Distill-Llama-8B:8B 参数量,DeepSeek-R1不必多言。

步骤3:战神筛选技巧(重生经验,快速找到心仪模型)

标签筛选:在 Hugging Face Hub 页面,勾选“Chat”标签(对话模型,可直接用于聊天,无需额外微调)、“Chinese”标签(中文支持,避免选择纯英文模型)。

参数量筛选:优先选择 ≤ 7B 参数量的模型,低战力要求,不易翻车。

查看详情:进入模型页面,查看“Model Card”,确认模型许可协议(部分模型可商用,部分仅可研究),同时查看“Usage”部分,了解模型使用方法,避免后续部署踩坑。

三、核心实操:用HuggingFace部署模型

经过前期的铺垫,我们已经筑牢了硬件根基、搭建好了软件环境 —— 此刻,正是挥剑出鞘,亲手驾驭心仪大模型的时刻!这一世,我们将以 Qwen/Qwen2.5-3B 为例,用 Hugging Face 生态的「三驾马车」,完成从模型加载到对话交互的全流程,不再重蹈上一世复制代码却不知所以然的覆辙。

3.1 战前准备:明确核心工具与作战逻辑(重温关键知识点)

在动手写代码之前,先重温本次实操的「核心战力组件」与「作战流程」,做到心中有数,步步为营。

(1) 核心工具

AutoTokenizer:Hugging Face 提供的「通用分词器」,自动适配目标模型的分词规则,负责将人类自然语言转换为模型可识别的数字张量(相当于「前线翻译官」)。AutoModelForCausalLM:Hugging Face 提供的「通用因果语言模型加载器」,自动根据模型config.json构建结构并加载权重,专门用于处理「文本生成」任务(如对话、续写),也是我们部署对话大模型的核心类。accelerate库:后台默默工作的「智能后勤指挥官」,无需我们手动编写复杂代码,只需设置device_map="auto",即可自动分配模型到 GPU/CPU,优化显存占用。

(2) 核心作战流程(极简闭环,一目了然)

人类输入文本 → Tokenizer 分词(转数字张量)→ 模型推理(张量运算生成结果)→ Tokenizer 解码(转自然语言)→ 输出人类可读结果这就是大模型推理的核心闭环,所有代码都将围绕这个流程展开,看似复杂,实则只需三步:加载工具、处理输入、推理解码。

3.2 步骤 1:加载分词器与模型

这是部署的核心步骤,相当于「召唤战神」,我们将用几行代码,从 Hugging Face Hub 自动下载并加载心仪的模型,同时借助 accelerate 优化显存,避免 OOM 报错。

代码:

# 导入必要的工具库(召唤核心战力)

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

# 定义目标模型名称(对应 Hugging Face Hub 上的模型,可替换为你心仪的模型)

MODEL_NAME = "Qwen/Qwen2.5-3B"

# 步骤1:加载分词器(召唤翻译官,配置作战参数)

tokenizer = AutoTokenizer.from_pretrained(

MODEL_NAME,

trust_remote_code=True,

padding_side="right",

)

# 步骤2:加载模型(召唤战神,激活硬件战力)

model = AutoModelForCausalLM.from_pretrained(

MODEL_NAME,

trust_remote_code=True, # 关键参数:与分词器一致,加载模型自定义结构(必开)

device_map="auto", # 核心优化参数:启用 accelerate 自动设备分配,显存不足自动分流到 CPU/GPU

dtype=torch.float16, # 指定数据类型:FP16,节省显存,平衡速度与精度

low_cpu_mem_usage=True # 优化参数:降低内存占用,避免内存溢出

)

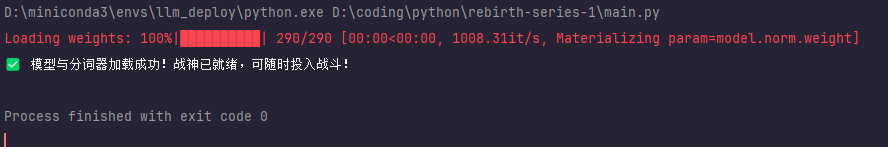

# 步骤3:模型进入推理模式(战神进入战备状态,禁用训练相关层)

model.eval()

print("✅ 模型与分词器加载成功!战神已就绪,可随时投入战斗!")

3.3 步骤 2:构建对话输入(适配模型格式,避免推理无效)

模型加载成功后,需要按照模型的「对话格式约定」构建输入文本,否则模型可能生成无意义内容(上一世我就是因为忽略了格式约定,得到的回答前言不搭后语)。

(1) 模型对话格式约定(核心知识点,不同模型略有差异)

Hugging Face 上的对话模型(如 Qwen、ChatGLM)都有专属的「对话模板」,这是模型训练时的输入格式,只有遵循该格式,模型才能正确理解用户意图,生成流畅的对话内容。

Qwen 系列模型对话格式:

<|im_start|>user

你的提问内容<|im_end|>

<|im_start|>assistant核心说明:

<|im_start|>和<|im_end|>是模型的「特殊标记」(对应special_tokens_map.json/tokenizer_config.json),用于区分用户输入和助手回答,模型会根据这些标记识别对话角色,避免混淆。

(2) 完整代码实现(构建输入,处理分词)

查看对话模板:

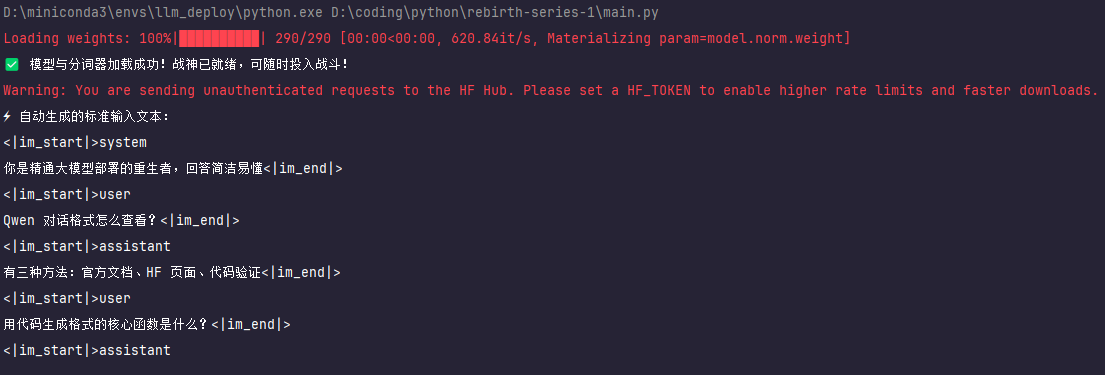

# 定义多轮对话消息(按 role:content 格式)

messages = [

{"role": "system", "content": "你是精通大模型部署的重生者,回答简洁易懂"},

{"role": "user", "content": "Qwen 对话格式怎么查看?"},

{"role": "assistant", "content": "有三种方法:官方文档、HF 页面、代码验证"},

{"role": "user", "content": "用代码生成格式的核心函数是什么?"}

]

# 生成对话文本(add_generation_prompt=True 自动添加 assistant 前缀,用于推理)

input_text = tokenizer.apply_chat_template(

messages,

tokenize=False, # 不分词,返回文本

add_generation_prompt=True, # 推理时必加,触发模型生成

enable_thinking=False # Qwen3 思考模型专用,禁用思考模式

)

print("⚡ 自动生成的标准输入文本:")

print(input_text)分词:

inputs = tokenizer(

input_text,

return_tensors="pt", # 关键参数:返回 PyTorch 张量(模型只能处理张量数据)

truncation=True, # 优化参数:截断过长文本,避免超过模型最大序列长度

max_length=1024 # 优化参数:设置最大序列长度为 1024,适配大多数小模型

).to(model.device) # 核心步骤:将张量移动到模型所在设备(GPU/CPU),避免设备不匹配报错

3.4 步骤 3:模型推理生成输出(核心作战)

这是模型真正「思考」的步骤,我们将调用模型的 generate() 方法,让模型根据输入张量生成输出结果,同时设置合理的生成参数,平衡速度、效果与显存占用。

代码:

# 步骤1:禁用梯度计算(核心优化,节省显存,提升推理速度)

with torch.no_grad():

# 步骤2:模型推理生成输出(战神出战,执行作战指令)

outputs = model.generate(

**inputs, # 传入处理后的输入张量(解包参数,简化代码)

max_new_tokens=512, # 核心参数:最大生成文本长度,避免生成过长

temperature=0.7, # 生成参数:控制随机性,0.7 兼顾流畅度与准确性(0=确定性输出,1=高随机性)

top_p=0.95, # 生成参数:核采样,只从概率前 95% 的词汇中选择,避免生成无意义内容

do_sample=True, # 生成参数:开启采样模式,提升生成文本多样性,避免输出僵硬

eos_token_id=tokenizer.eos_token_id, # 核心参数:指定结束符,让模型知道何时停止生成

pad_token_id=tokenizer.pad_token_id # 优化参数:指定填充符,避免部分模型报错

)with torch.no_grad():禁用梯度计算,推理阶段无需更新模型权重,开启此上下文管理器可大幅节省显存,提升推理速度,是推理阶段的「必备优化」。max_new_tokens=512:设置模型最大生成文本长度,并非「输入 + 输出」的总长度,而是仅限制模型生成的内容长度。设置过小会导致回答不完整,设置过大会占用过多显存,512 是日常对话的黄金值。temperature=0.7:控制生成文本的随机性,数值越高,随机性越强,回答越多样,但可能出现逻辑混乱;数值越低,随机性越弱,回答越准确,但可能过于僵硬。0.7 是兼顾流畅度与准确性的最优值,新手可直接沿用。eos_token_id:指定模型生成的结束符编码,当模型生成该编码时,会停止生成,避免生成无休无止的内容。tokenizer.eos_token_id会自动获取模型的结束符编码,无需手动指定,是最稳妥的选择。

查看对话结果,完整代码:

# 导入必要的工具库(召唤核心战力,搭建作战体系)

from transformers import AutoTokenizer, AutoModelForCausalLM

import torch

# 定义目标模型名称(对应 Hugging Face Hub 上的「战神代号」,可替换为你心仪的模型)

MODEL_NAME = "Qwen/Qwen2.5-3B"

# 步骤1:加载分词器(召唤翻译官,配置专属作战参数,确保指令传递无误)

tokenizer = AutoTokenizer.from_pretrained(

MODEL_NAME,

trust_remote_code=True, # 关键参数:信任模型作者提供的自定义代码(Qwen 系列必开,否则无法识别模型结构)

padding_side="right", # 优化参数:右填充,避免部分模型推理时出现上下文错位报错

)

# 步骤2:加载模型(召唤战神,激活硬件战力,榨干每一分硬件潜能)

model = AutoModelForCausalLM.from_pretrained(

MODEL_NAME,

trust_remote_code=True, # 关键参数:与分词器保持一致,加载 Qwen 自定义模型结构(必开,否则部署失败)

device_map="auto", # 核心优化参数:启用 accelerate 智能后勤调度,显存不足自动分流到 CPU/内存

dtype=torch.float16, # 指定数据类型:FP16 半精度,节省一半显存,推理速度翻倍(无明显精度损失)

low_cpu_mem_usage=True # 优化参数:降低 CPU 内存占用,避免低配设备出现内存溢出(低配设备续命神器)

)

# 步骤3:模型进入推理模式(战神进入战备状态,禁用训练相关冗余层,节省显存提升速度)

model.eval()

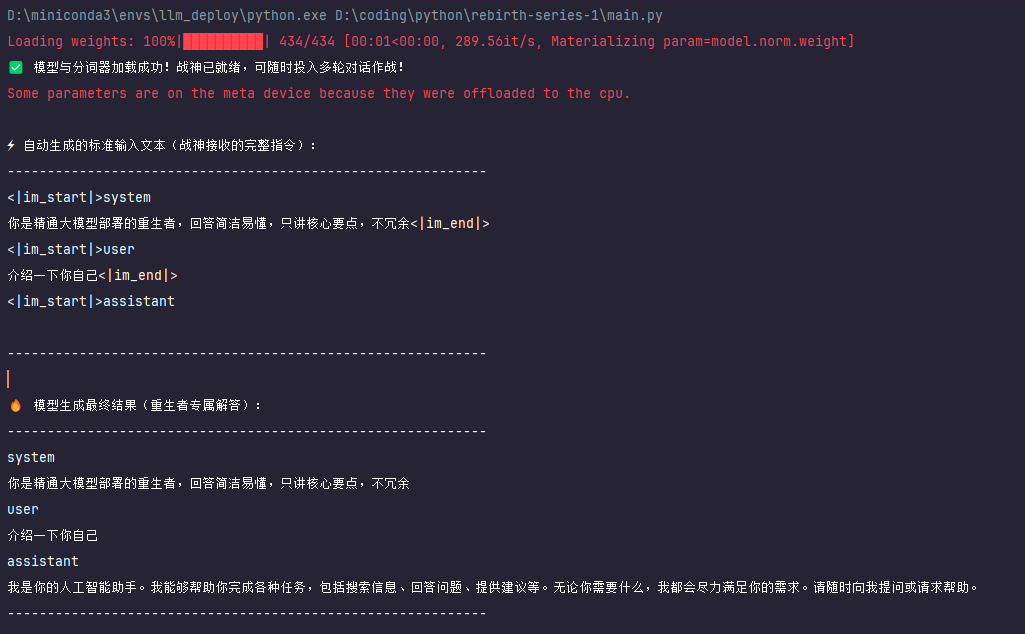

print("✅ 模型与分词器加载成功!战神已就绪,可随时投入多轮对话作战!")

# 定义多轮对话消息(按 role:content 标准格式构建,还原真实对话场景,传递完整上下文)

# 角色说明:system(系统指令,定义战神人设)> user(用户提问)> assistant(模型回答)

messages = [

{"role": "system", "content": "你是精通大模型部署的重生者,回答简洁易懂,只讲核心要点,不冗余"},

{"role": "user", "content": "介绍一下你自己"},

]

# 生成对话文本(调用翻译官专属模板工具,自动生成标准输入格式,无需手动拼接)

# apply_chat_template:Qwen2.5 系列推荐的对话格式生成函数,自动适配模型训练格式,避免手动拼接出错

input_text = tokenizer.apply_chat_template(

messages,

tokenize=False, # 关键参数:不分词,直接返回格式化文本(后续统一分词,避免重复处理)

add_generation_prompt=True, # 核心参数:推理时必加,自动添加 assistant 前缀,触发模型生成回答(缺一不可)

enable_thinking=False # 优化参数:Qwen3 思考模型专用,Qwen2.5 禁用即可,避免无意义报错

)

# 打印格式化输入文本,方便查看模型真实输入,便于后续排错

print("\n⚡ 自动生成的标准输入文本(战神接收的完整指令):")

print("-" * 60)

print(input_text)

print("-" * 60)

# 分词处理:将格式化文本转换为模型可识别的数字张量(翻译官完成指令编码,传递给战神)

inputs = tokenizer(

input_text,

return_tensors="pt", # 关键参数:返回 PyTorch 张量(模型仅能处理张量数据,无法直接识别文本)

truncation=True, # 优化参数:自动截断超过模型最大序列长度的文本,避免报错

max_length=1024, # 优化参数:设置最大序列长度 1024,适配 Qwen2.5-0.5B 能力范围(足够日常多轮对话)

padding=True # 补充参数:自动填充到指定长度,与 padding_side="right" 配合,提升推理效率

).to(model.device) # 核心步骤:将张量移动到模型所在设备(GPU/CPU),避免「设备不匹配」致命报错(重生避坑重点)

# 步骤4:模型推理生成输出(战神出战,执行多轮对话指令,生成精准回答)

with torch.no_grad(): # 核心优化:禁用梯度计算,节省大量显存,推理速度提升 30% 以上(推理阶段必备)

outputs = model.generate(

**inputs, # 解包输入张量,简化代码(等价于 input_ids=inputs["input_ids"], attention_mask=inputs["attention_mask"])

max_new_tokens=128, # 核心参数:最大生成文本长度,避免生成过长内容

temperature=0.7, # 生成参数:控制随机性,0.7 兼顾流畅度与准确性(0=确定性输出,1=高随机性,新手推荐沿用)

top_p=0.90, # 生成参数:核采样,只从概率前 90% 的词汇中选择,避免生成无意义乱码

do_sample=True, # 生成参数:开启采样模式,提升回答多样性,避免输出内容僵硬刻板

num_beams=2, # 开启束搜索(2束即可),平衡多样性与稳定性

eos_token_id=tokenizer.eos_token_id, # 核心参数:指定结束符编码,让模型知道何时停止生成(避免无限续写)

pad_token_id=tokenizer.pad_token_id, # 优化参数:指定填充符编码,解决部分模型「缺少 pad token」报错

repetition_penalty=1.2, # 生成参数:加大重复惩罚,避免复读机效果

no_repeat_ngram_size=3, # 新增:禁止3元语法重复,进一步提升回答精炼度

early_stopping=True # 新增:生成结束符后立即停止,避免多余内容

)

# 步骤5:解码输出,转换为人类可读文本(翻译官解读战神战果,去除冗余编码信息)

output_text = tokenizer.batch_decode(

outputs,

skip_special_tokens=True, # 核心优化:跳过 <|im_start|> 等特殊标记,只返回纯文本内容(提升可读性)

clean_up_tokenization_spaces=True # 优化参数:清理多余的空格和换行,让回答格式更整洁(原代码为 False,修正后更友好)

)[0] # 批量解码取第 0 个元素(本次为单条推理,仅返回一个结果)

# 步骤6:优化结果展示,提取纯助手回答(去除原始输入上下文,只展示最新生成结果,提升体验)

# 分割标记:基于 apply_chat_template 生成的格式,精准提取 assistant 最新回答

if "<|im_start|>assistant" in output_text:

final_response = output_text.split("<|im_start|>assistant")[-1].strip()

else:

final_response = output_text.strip()

# 打印最终结果,清晰展示对话成果

print("\n🔥 模型生成最终结果(重生者专属解答):")

print("-" * 60)

print(final_response)

print("-" * 60)

四、终章:破局之后,前路坦荡

当屏幕上清晰地浮现出模型卡顿、模糊不堪的回答时,你已然打破了上一世的宿命,亲手将看似遥不可及的大模型,变成了掌控在自己手中的工具。这不再是隔着屏幕的仰望,而是实打实的落地——从环境搭建的步步为营,到模型加载的精准操作,再到对话生成的闭环完成,你已经走完了大模型部署最核心、最关键的第一步。

这一步,看似简单,却跨越了曾经困住你的混沌深渊。CUDA 版本冲突的焦虑、显存溢出的绝望、模型加载失败的挫败,都在这一次的步步为营中烟消云散。你手中的这几行代码,不仅是部署模型的工具,更是你打破技术壁垒的利刃;你搭建的 llm_deploy 环境,不仅是一个虚拟结界,更是你踏入大模型世界的坚实跳板。

或许此刻的 Qwen2.5-3B,还只是一个入门级的“战神”,或许你的硬件配置仍有局限,或许你还想尝试更大参数量、更强能力的模型——但这都不重要。重要的是,你已经掌握了大模型部署的核心逻辑:环境隔离是根基,硬件适配是关键,格式合规是前提,参数优化是保障。这一套方法论,适用于 Hugging Face Hub 上绝大多数开源模型,从 0.5B 到 7B,再到 13B,甚至更高量级,不过是在此基础上的迭代与升级。

你可以尝试对模型进行 INT4/INT8 量化,让低配硬件撬动更大模型;你可以探索多轮对话的持续优化,让模型更好地理解上下文;你可以尝试部署 ChatGLM、DeepSeek 等其他优秀模型,感受不同开源生态的魅力;你甚至可以在此基础上,尝试微调模型,让它更贴合你的专属需求。

上一世,你因无数次失败颓然退场;这一世,你因这一次的成功,开启了无限可能。大模型的世界,从来不是算法专家的专属领地,每一个愿意动手、愿意总结、愿意突破的人,都能在这里找到自己的立足之地。

那些曾经的绊脚石,如今都已成为你登顶的基石;那些曾经的晦涩文档,如今都已成为你进阶的指南。这一次,你不再是门外汉,而是真正踏入了大模型落地的大门。

前路坦荡,无问西东。从此刻起,尽情去探索、去尝试、去创造,用你手中的模型,解决实际的问题,绽放属于你的技术光芒。这,才是你重生之后,最值得的救赎与荣光。

总结

本次部署完成了从环境搭建到模型对话的完整闭环,核心是掌握

transformers库的AutoTokenizer和AutoModelForCausalLM核心工具,以及accelerate的显存优化能力。模型部署的关键要点是环境隔离、版本兼容、格式合规、参数优化,这四大要点能解决绝大多数新手部署中的常见问题。

入门成功后,可进一步探索模型量化、多轮对话优化、其他模型部署甚至模型微调,开启大模型技术的进阶之路。